이 콘텐츠는 사이트 회원 전용입니다. 기존의 사용자라면 로그인 하세요. 새 사용자는 아래에서 회원가입 할 수 있습니다.

구글, 스파스 추론으로 뉴럴네트워크 고속화

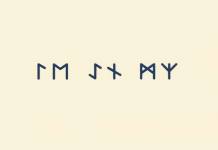

구글이 모바일용 기계 학습 라이브러리 텐서플로 라이트(TensorFlow Lite)와 신경망 추론 최적화 라이브러리 XNNPACK에 추가적인 스파스(Sparse) 최적화를 적용해 추론 속도를 크게 향상시켰다고 발표했다. 스파스(Sparse)는 '척척'을 의미하는 단어다. 빅데이터 등 해석에서 데이터 전체는 대규모이지만 의미 있는 데이터는 극히 일부밖에 없는 상황이 많다. 스파스 모델링은 이러한 성질을 가진 데이터를 취사선택하고 의미 있는 데이터만

![[보고서] 딥씨크 출현과 한국 AI 미래전략](http://www.itnews.or.kr/wp-content/uploads/2025/02/7-218x150.png)

![[2024 애플 동향] ③ 애플카 ‘프로젝트 타이탄’의 실패 원인](http://www.itnews.or.kr/wp-content/uploads/2024/03/1-2-218x150.png)

![[2024 애플 동향] ② 애플카 ‘프로젝트 타이탄’ 10년간 의 여정](http://www.itnews.or.kr/wp-content/uploads/2024/03/4-218x150.png)

![[2024 애플 동향] ① 애플 프로젝트 타이탄’ 종료](http://www.itnews.or.kr/wp-content/uploads/2024/03/Midjourney-218x150.png)